Freitag, 4. Februar 2011

Vorlesung zur String-Twistoren-Revolution

klauslange,23:52h

Ein sehr interessantes Video einer Vorlesung zur String-Twistoren-Revolution findet sich hier:

http://streamer.perimeterinstitute.ca/mediasite/viewer/NoPopupRedirector.aspx?peid=ff8f97a4-2848-4b93-98d9-1218de2070af&shouldResize=False

http://streamer.perimeterinstitute.ca/mediasite/viewer/NoPopupRedirector.aspx?peid=ff8f97a4-2848-4b93-98d9-1218de2070af&shouldResize=False

... link (0 Kommentare) ... comment

Dienstag, 1. Februar 2011

LHC läuft auch 2012

klauslange,21:30h

Bislang wurde geplant das LHC im Jahre 2012 ruhen zu lassen, um neue Konfigurationen vorzunehmen, die höhere Energien ermöglichen. Aufgrund vielversprechender Messergebnisse wird das LHC aber über Ende 2011 auch 2012 laufen und erst danach eine längere Pause einlegen:

http://www.weltderphysik.de/de/4293.php?ni=2414

http://www.weltderphysik.de/de/4293.php?ni=2414

... link (0 Kommentare) ... comment

Samstag, 8. Januar 2011

Gammastrahlenausbrüche sprengen Theorie

klauslange,17:01h

Diese reißerische Überschrift kommt nicht etwa von mir, sondern gebraucht als Kurzbeschreibung scinexx:

http://www.g-o.de/wissen-aktuell-12799-2011-01-07.html

Zitat:

Dramatische Gammastrahlenausbrüche im Nebel sprengen astrophysikalische Grundannahmen

Bisher galt die Strahlung des Krebsnebels, eines Supernova-Relikts, als so konstant, dass sie als Referenzwert diente. Doch jetzt berichten Astrophysiker in „Science“ von gleich mehreren dramatischen Gammastrahlenausbrüchen im Krebsnebel – die Standardkerze flackert. Und dies mit einer so hohen Intensität, dass alle bisherigen Modelle der kosmischen Teilchenbeschleunigung sie nicht erklären können...

Pulsar ist nicht die Strahlenquelle

Woher aber stammt diese Strahlung? Seltsamerweise gab es während dieser beiden Ausbrüche keinerlei Anzeichen für Veränderungen am Kerbnebelpulsar – eigentlich der naheliegenden Quelle so gewaltiger Energiemengen. Die dramatischen Gammastrahlenausbrüche erreichen Stärken im Gigaelektronenvolt-Bereich. Eine Gammastrahlenintensität in dieser Größenordnung bedeutet aber, dass die zugrundeliegenden Elektronen und Positronen bei den typischen Magnetfeldstärken im Krebsnebels mindestens auf Petaelektronenvolt-Energie beschleunigt worden sein müssen. Dies ist ein neuer Superlativ – es sind damit die höchstenergetischen geladenen Teilchen, die mit einem bekannten astronomischen Objekt in Beziehung gebracht werden können.

Energieintensität sprengt sämtliche Modelle

Doch genau diese Energieintensität ist das Rätselhafte: da der Pulsar nicht die Quelle zu sein scheint, müssen die Gammastrahlen aus dem Nebel selbst stammen. Da die beobachteten Intensitätsschwankungen innerhalb von nur wenigen Tagen stattfanden, vermuten die Astrophysiker, dass die Energie dabei aus einem verhältnismäßig kleinen Gebiet im Krebsnebel stammen muss. Die bislang bekannten Mechanismen können diesen Prozess jedoch nicht erklären.

„Unsere Vorstellungen, wie ein derart immenser Energiegewinn in solch kleinen Gebieten realisiert werden können, müssen jetzt neu hinterfragt werden“, erklärt Olaf Reimer Astrophysiker der Universität Innsbruck und Forscher in der Fermi Large Area Telescope (LAT) Kollaboration. „Die Zeitskalen der Strahlungsausbrüche sind dergestalt, dass die Elektronen einfach nicht genug Zeit hatten, auf ihrer Bewegung entlang der Magnetfeldlinien zu derartigen Energien beschleunigt zu werden.“

Ende einer Epoche

Nach diesen Beobachtungen steht in jedem Fall fest, dass der Krebsnebel, die erste Quelle, die einst am Himmel im Lichte der energiereichsten Gammastrahlung entdeckt wurde, nicht mehr vorbehaltlos als Referenz genutzt werden kann. Wenn solche Standardkerzen flackern, deutet sich das Ende einer Epoche an. Offenbar gibt es in der Erforschung der Hochenergiephänomene am Himmel mehr Lücken, als bisher angenommen.

Kommentar:

Also wissenschaftlich fängt das Jahr wirklich gut an...

http://www.g-o.de/wissen-aktuell-12799-2011-01-07.html

Zitat:

Dramatische Gammastrahlenausbrüche im Nebel sprengen astrophysikalische Grundannahmen

Bisher galt die Strahlung des Krebsnebels, eines Supernova-Relikts, als so konstant, dass sie als Referenzwert diente. Doch jetzt berichten Astrophysiker in „Science“ von gleich mehreren dramatischen Gammastrahlenausbrüchen im Krebsnebel – die Standardkerze flackert. Und dies mit einer so hohen Intensität, dass alle bisherigen Modelle der kosmischen Teilchenbeschleunigung sie nicht erklären können...

Pulsar ist nicht die Strahlenquelle

Woher aber stammt diese Strahlung? Seltsamerweise gab es während dieser beiden Ausbrüche keinerlei Anzeichen für Veränderungen am Kerbnebelpulsar – eigentlich der naheliegenden Quelle so gewaltiger Energiemengen. Die dramatischen Gammastrahlenausbrüche erreichen Stärken im Gigaelektronenvolt-Bereich. Eine Gammastrahlenintensität in dieser Größenordnung bedeutet aber, dass die zugrundeliegenden Elektronen und Positronen bei den typischen Magnetfeldstärken im Krebsnebels mindestens auf Petaelektronenvolt-Energie beschleunigt worden sein müssen. Dies ist ein neuer Superlativ – es sind damit die höchstenergetischen geladenen Teilchen, die mit einem bekannten astronomischen Objekt in Beziehung gebracht werden können.

Energieintensität sprengt sämtliche Modelle

Doch genau diese Energieintensität ist das Rätselhafte: da der Pulsar nicht die Quelle zu sein scheint, müssen die Gammastrahlen aus dem Nebel selbst stammen. Da die beobachteten Intensitätsschwankungen innerhalb von nur wenigen Tagen stattfanden, vermuten die Astrophysiker, dass die Energie dabei aus einem verhältnismäßig kleinen Gebiet im Krebsnebel stammen muss. Die bislang bekannten Mechanismen können diesen Prozess jedoch nicht erklären.

„Unsere Vorstellungen, wie ein derart immenser Energiegewinn in solch kleinen Gebieten realisiert werden können, müssen jetzt neu hinterfragt werden“, erklärt Olaf Reimer Astrophysiker der Universität Innsbruck und Forscher in der Fermi Large Area Telescope (LAT) Kollaboration. „Die Zeitskalen der Strahlungsausbrüche sind dergestalt, dass die Elektronen einfach nicht genug Zeit hatten, auf ihrer Bewegung entlang der Magnetfeldlinien zu derartigen Energien beschleunigt zu werden.“

Ende einer Epoche

Nach diesen Beobachtungen steht in jedem Fall fest, dass der Krebsnebel, die erste Quelle, die einst am Himmel im Lichte der energiereichsten Gammastrahlung entdeckt wurde, nicht mehr vorbehaltlos als Referenz genutzt werden kann. Wenn solche Standardkerzen flackern, deutet sich das Ende einer Epoche an. Offenbar gibt es in der Erforschung der Hochenergiephänomene am Himmel mehr Lücken, als bisher angenommen.

Kommentar:

Also wissenschaftlich fängt das Jahr wirklich gut an...

... link (0 Kommentare) ... comment

Mittwoch, 5. Januar 2011

Urwort - Theorie

klauslange,12:57h

Dr. Michael König hat ein interessantes Buch geschrieben, das ich nun gelesen habe und mich gedanklich weiterhin beschäftigt.

Er beschreibt die Struktur des G4-Raums der Heim-Theorie als vierdimensionalen Hyperraum, aber auch jene des S2 und des I2 als eine innere Raumzeit von Teilchen, wobei diese innere Teilchenraumzeit eher eine 1+3 Aufteilung anstatt der 3+1-Aufteilung unserer bekannten äußeren Raumzeit besitzt.

Interessant ist dieses Buch und seine Theorie aber nicht nur für Leute, die sich, wie ich, mit der Theorie von Burkhard Heim (1925 - 2001) beschäftigt haben (siehe http://evolution-schoepfung.blogspot.com/2010/06/jenseits-aller-evolution-kausalitat.html ). Diese Arbeit basiert auch auf die komplexe Relativitätstheorie des Nuklearphysikers Jean Emile Charon (1920 - 1998), der eben jene inneren Raumzeiten von Teilchen propagierte und unter Benutzung von komplexen Koordinaten auch begründete.

Später werde ich mehr zur komplexen Relativitätstheorie schreiben. Für jetzt möchte ich kurz auf den G4 und das Urwort eingehen:

König beschreibt diesen G4 als Hyperraum aus 4 Raumdimensionen mit einer punktsymmetrischen Quelle Lambda. Aus dieser Quelle gehen dann in vier unabhängigen Richtungen - den Raumdimensionen - Teilchen hervor, die er als Eta-Teilchen bezeichnet. Wegen der abgestrahlten Etas bezeichnet König die Quelle Lambda auch als ELI und setzt mit ihr Gott gleich, aus dem alles kommt. Diese Etas quantisieren zum einen die Raumstruktur aus eindimensionalen Entitäten und zum anderen können sie als freie Teilchen auftreten, die dann als Fermionen mit halbzahligen Spin auftreten und in unserer Raumzeit als Neutrinos in Erscheinung treten.

Das finde ich sehr interessant. Wenn man die Herkunft und vierdimensionale raumbildende Eigenschaft der Eta-(Struktur-)Teilchen bedenkt, kommt man leicht auf den Gedanken, dass es für die Neutrinos nicht nur drei Teilchengenerationen geben darf. Ferner wird sofort einsichtig, warum die Neutrinos zwischen den Generationen oszillieren, weil sie eben der einheitlichen Etateilchen-Quelle Lambda direkt entspringen.

Wenn man nun das Modell Jean Emile Charons zugrunde legt, dann ist zu erwarten, dass es auch zumindest für die Quarks einer weiteren Teilchengeneration bedarf. Insofern lässt sich aus dem Urwort-Modell zumindest qualitativ eine entsprechend prüfbare Vorhersage erschließen. Dies erwähnt zwar nicht der Autor, aber ich bin der Meinung, dass es zumindest ein weiteres Neutrino-Teilchen neben Elektron-, Myon- und Tau-Neutrino geben muss, wenn die Urwort-Theorie korrekt ist.

Leider hat der Autor bislang auf einen Formelapparat verzichtet, aber aus den im Buch ausführlich dargelegten Überlegungen kann man dennoch Schlussfolgerungen ziehen.

Eine weitere ergibt sich aus dem Energiefluss der Eta-Teilchen, die nicht nur von der Lambda-Quelle weg, sondern auch zu ihr hin fließen. Wobei es einen Überschuss von wegfließenden Eta-Teilchen (oder genauer von Energie auf dem Eta-Teilchen) gibt. Deswegen beschreibt König die Eta-Teilchen als eine Art von Doppelvektoren.

Das ist wiederum spannend. Wenn man sich vorstellt, dass Spinoren im wesentlichen als eine Art Quadratwurzel von Vektoren aufgefasst werden können, dann schließen wir daraus, dass zumindest die Neutrinos in ihre eigenen Anti-Teilchen mit gegenläufigem Spin oszillieren können sollten, wobei dann aber eine Paritätsverletzung auftreten sollte. Auch davon schreibt der Autor nichts. Das soll kein Vorwurf sein, ich will nur klarstellen, dass ich ihm nichts in den Mund - oder ins Buch - legen möchte.

Somit habe ich zumindest zwei mögliche Experimental-Kriterien, um entweder zu sehen, ob an der Theorie 'etwas dran' ist oder auch, ob ich den Autor richtig verstanden habe und daher meine Schlussfolgerungen korrekt sind.

Um den Hyperraum zu komplettieren erkennt König, dass der erste Quantisierungsschritt der Eta-Teilchen Strukturflüsse erzeugt, die er Phi und Chi nennt, wobei gilt

div Phi = 0

rot Chi = 0

in Analogie zu magnetischen und elektrischen Feldern.

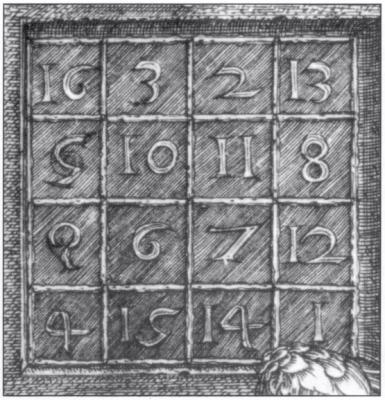

Im Übergang zur inneren und äußeren Raumzeit existieren dann sogenannte Theta - Wirbel, die durch das Paulische Ausschließungsprinzip bzgl. Fermionen erzeugt werden. Wodurch Partialstrukturen einer zeitartigen Dimension (mit Orientierung von einem Anfang zu einem Ende und daher als Alpha und Omega bezeichnet) auftreten. Auf dem Buch-Cover sieht man dann das sich schematisch ergebende Uwort als 5x5-Matrix, wobei die zentrale innere 3x3-Matrix den G4 darstellt.

Eine wirklich empfehlenswerte Lektüre!

Michael König - Das Urwort

Scorpio Verlag

Er beschreibt die Struktur des G4-Raums der Heim-Theorie als vierdimensionalen Hyperraum, aber auch jene des S2 und des I2 als eine innere Raumzeit von Teilchen, wobei diese innere Teilchenraumzeit eher eine 1+3 Aufteilung anstatt der 3+1-Aufteilung unserer bekannten äußeren Raumzeit besitzt.

Interessant ist dieses Buch und seine Theorie aber nicht nur für Leute, die sich, wie ich, mit der Theorie von Burkhard Heim (1925 - 2001) beschäftigt haben (siehe http://evolution-schoepfung.blogspot.com/2010/06/jenseits-aller-evolution-kausalitat.html ). Diese Arbeit basiert auch auf die komplexe Relativitätstheorie des Nuklearphysikers Jean Emile Charon (1920 - 1998), der eben jene inneren Raumzeiten von Teilchen propagierte und unter Benutzung von komplexen Koordinaten auch begründete.

Später werde ich mehr zur komplexen Relativitätstheorie schreiben. Für jetzt möchte ich kurz auf den G4 und das Urwort eingehen:

König beschreibt diesen G4 als Hyperraum aus 4 Raumdimensionen mit einer punktsymmetrischen Quelle Lambda. Aus dieser Quelle gehen dann in vier unabhängigen Richtungen - den Raumdimensionen - Teilchen hervor, die er als Eta-Teilchen bezeichnet. Wegen der abgestrahlten Etas bezeichnet König die Quelle Lambda auch als ELI und setzt mit ihr Gott gleich, aus dem alles kommt. Diese Etas quantisieren zum einen die Raumstruktur aus eindimensionalen Entitäten und zum anderen können sie als freie Teilchen auftreten, die dann als Fermionen mit halbzahligen Spin auftreten und in unserer Raumzeit als Neutrinos in Erscheinung treten.

Das finde ich sehr interessant. Wenn man die Herkunft und vierdimensionale raumbildende Eigenschaft der Eta-(Struktur-)Teilchen bedenkt, kommt man leicht auf den Gedanken, dass es für die Neutrinos nicht nur drei Teilchengenerationen geben darf. Ferner wird sofort einsichtig, warum die Neutrinos zwischen den Generationen oszillieren, weil sie eben der einheitlichen Etateilchen-Quelle Lambda direkt entspringen.

Wenn man nun das Modell Jean Emile Charons zugrunde legt, dann ist zu erwarten, dass es auch zumindest für die Quarks einer weiteren Teilchengeneration bedarf. Insofern lässt sich aus dem Urwort-Modell zumindest qualitativ eine entsprechend prüfbare Vorhersage erschließen. Dies erwähnt zwar nicht der Autor, aber ich bin der Meinung, dass es zumindest ein weiteres Neutrino-Teilchen neben Elektron-, Myon- und Tau-Neutrino geben muss, wenn die Urwort-Theorie korrekt ist.

Leider hat der Autor bislang auf einen Formelapparat verzichtet, aber aus den im Buch ausführlich dargelegten Überlegungen kann man dennoch Schlussfolgerungen ziehen.

Eine weitere ergibt sich aus dem Energiefluss der Eta-Teilchen, die nicht nur von der Lambda-Quelle weg, sondern auch zu ihr hin fließen. Wobei es einen Überschuss von wegfließenden Eta-Teilchen (oder genauer von Energie auf dem Eta-Teilchen) gibt. Deswegen beschreibt König die Eta-Teilchen als eine Art von Doppelvektoren.

Das ist wiederum spannend. Wenn man sich vorstellt, dass Spinoren im wesentlichen als eine Art Quadratwurzel von Vektoren aufgefasst werden können, dann schließen wir daraus, dass zumindest die Neutrinos in ihre eigenen Anti-Teilchen mit gegenläufigem Spin oszillieren können sollten, wobei dann aber eine Paritätsverletzung auftreten sollte. Auch davon schreibt der Autor nichts. Das soll kein Vorwurf sein, ich will nur klarstellen, dass ich ihm nichts in den Mund - oder ins Buch - legen möchte.

Somit habe ich zumindest zwei mögliche Experimental-Kriterien, um entweder zu sehen, ob an der Theorie 'etwas dran' ist oder auch, ob ich den Autor richtig verstanden habe und daher meine Schlussfolgerungen korrekt sind.

Um den Hyperraum zu komplettieren erkennt König, dass der erste Quantisierungsschritt der Eta-Teilchen Strukturflüsse erzeugt, die er Phi und Chi nennt, wobei gilt

div Phi = 0

rot Chi = 0

in Analogie zu magnetischen und elektrischen Feldern.

Im Übergang zur inneren und äußeren Raumzeit existieren dann sogenannte Theta - Wirbel, die durch das Paulische Ausschließungsprinzip bzgl. Fermionen erzeugt werden. Wodurch Partialstrukturen einer zeitartigen Dimension (mit Orientierung von einem Anfang zu einem Ende und daher als Alpha und Omega bezeichnet) auftreten. Auf dem Buch-Cover sieht man dann das sich schematisch ergebende Uwort als 5x5-Matrix, wobei die zentrale innere 3x3-Matrix den G4 darstellt.

Eine wirklich empfehlenswerte Lektüre!

Michael König - Das Urwort

Scorpio Verlag

... link (14 Kommentare) ... comment

Montag, 3. Januar 2011

Twistoren - Revolution in der String-/M-Theorie?

klauslange,23:02h

Dieses Jahr nimmt einen vielversprechenden Anfang, wenn man auf die Superstring- bzw. M-Theorie schaut. Konzeptionell elegant, aber immer noch mit dem Mangel behaftet, dass aus ihr keine konkreten Eigenschaften für Teilchen berechnet werden kann.

Das könnte sich nun bald ändern, denn neue Arbeiten zeigen einen Weg auf, wie dieser Mangel behoben werden kann. Mit Hilfe der von Sir Roger Penrose 1967 entwickelten Twistoren-Rechnung.

Da es in der Superstringtheorie schon zwei große Revolutionen - also wichtige Fortschritte - gegeben hat, nennt Lubos Motl die jetzigen Arbeiten bislang eine Mini-Revolution. Doch es sei gesagt, dass sich diese Minirevolution sehr schnell und sehr bald zu einer ausgewachsenen dritten Superstring-Revolution auswachsen kann.

Hier die Neuigkeit im Detail:

http://motls.blogspot.com/2011/01/twistor-minirevolution-goes-on.html

Hier noch ein zusätzlicher Artikel zu den Grundlagen der Twistor-Theorie im Zusammenhang mit der Stringtheorie:

http://www.wissenschaft.de/wissenschaft/news/243537.html

Zum letztgenannten Artikel ist zu sagen, dass man es bei den Twistoren mit komplexen Koordinaten zu tun hat, nicht nur mit reellen. Wer sagt denn, dass in diesem physikalischen Zusammenhang die Imaginärteile nicht auch eine reale Entsprechung haben? Die Lösungen z = i bzw. z = -i für z^2 = -1 sind nicht weniger existent als x = 1 bzw. x = -1 für x^2 = 1. Wenn es in einer physikalischen Theorie eine raumzeitliche Entsprechung für den Realteil einer Zahl gibt, so kann das auch für den Imaginärteil einer Zahl nicht ausgeschlossen werden.

Der Atomphysiker Jean Emile Charon mit seiner komplexen Relativitätstheorie hat hierzu mit der Propagierung der äußeren (bekannten) Raumzeit für die Realteile und der inneren Teilchenraumzeit für die Imaginärteile seiner komplexen Zahlen einen interessanten Weg gezeigt, was für mich die Twistorenentwicklung so spannend macht.

Das könnte sich nun bald ändern, denn neue Arbeiten zeigen einen Weg auf, wie dieser Mangel behoben werden kann. Mit Hilfe der von Sir Roger Penrose 1967 entwickelten Twistoren-Rechnung.

Da es in der Superstringtheorie schon zwei große Revolutionen - also wichtige Fortschritte - gegeben hat, nennt Lubos Motl die jetzigen Arbeiten bislang eine Mini-Revolution. Doch es sei gesagt, dass sich diese Minirevolution sehr schnell und sehr bald zu einer ausgewachsenen dritten Superstring-Revolution auswachsen kann.

Hier die Neuigkeit im Detail:

http://motls.blogspot.com/2011/01/twistor-minirevolution-goes-on.html

Hier noch ein zusätzlicher Artikel zu den Grundlagen der Twistor-Theorie im Zusammenhang mit der Stringtheorie:

http://www.wissenschaft.de/wissenschaft/news/243537.html

Zum letztgenannten Artikel ist zu sagen, dass man es bei den Twistoren mit komplexen Koordinaten zu tun hat, nicht nur mit reellen. Wer sagt denn, dass in diesem physikalischen Zusammenhang die Imaginärteile nicht auch eine reale Entsprechung haben? Die Lösungen z = i bzw. z = -i für z^2 = -1 sind nicht weniger existent als x = 1 bzw. x = -1 für x^2 = 1. Wenn es in einer physikalischen Theorie eine raumzeitliche Entsprechung für den Realteil einer Zahl gibt, so kann das auch für den Imaginärteil einer Zahl nicht ausgeschlossen werden.

Der Atomphysiker Jean Emile Charon mit seiner komplexen Relativitätstheorie hat hierzu mit der Propagierung der äußeren (bekannten) Raumzeit für die Realteile und der inneren Teilchenraumzeit für die Imaginärteile seiner komplexen Zahlen einen interessanten Weg gezeigt, was für mich die Twistorenentwicklung so spannend macht.

... link (0 Kommentare) ... comment

Dienstag, 21. Dezember 2010

Extra Jahr für das LHC?

klauslange,17:31h

Die bislang gezeigten Ergebnisse des LHC scheinen so vielversprechend zu sein, dass das geplante Ende der ersten Messkampagne Ende 2011 um ein Jahr verschoben wird. So jedenfalls der Vorschlag einiger Forschergruppen, wie Nature berichtet:

http://www.nature.com/news/2010/101210/full/news.2010.667.html?s=news_rss&utm_source=feedburner&utm_medium=feed&utm_campaign=Feed%3A+news%2Frss%2Fmost_recent+%28NatureNews+-+Most+recent+articles%29

If the plan is implemented, the Large Hadron Collider (LHC), located at CERN, near Geneva, Switzerland, will run until the end of 2012 — rather than 2011 — before entering a year-long shutdown for a major upgrade. Preparations for the extended run, which would see the 27-kilometre circular collider operating over three continuous years, are being finalized and are likely to be agreed to by CERN's management and council in January.

The decision comes with the belief that new discoveries may be just around the corner. "It would be a shame to stop," says Steve Myers, who is responsible for maintaining and upgrading the accelerator.

...

Initially, there were doubts about whether the LHC would be able to find the Higgs at the machine's current energies. Since a major accident in 2008, the LHC has been running at half its design energy. CERN managers had planned a 15-month pause in data collecting at the start of 2012, which would allow the machine to be upgraded to full power.

But now there is a growing consensus that the LHC will be able to cover most of the territory in which a standard Higgs particle might be found, even if it isn't upgraded. The best guess of most physicists is that the Higgs weighs somewhere between 114 and 600 gigaelectronvolts (109 electronvolts), according to Sergio Bertolucci, CERN's director for research and computing. Its mass will determine how the particle decays — and how easily it can be detected.

Paradoxically, a heavier Higgs might be easier to spot, Bertolucci says. That's because the heavy Higgs is likely to decay into pairs of rare, heavy particles known as W and Z bosons. Pairs of Ws or Zs would stand out sharply against the other particles created in LHC collisions. If the Higgs were lighter, its signature would blend into the background, making it much harder to detect and requiring physicists to amass and filter through data from months of collisions...

But keeping the machine running for an extra year will have consequences. The delicate alignment of the LHC's superconducting magnets could suffer, requiring extra maintenance, says Myers. And additional computing resources will have to be found to handle the flood of extra data produced by the detectors.

Managers recognize the difficulties, but Bertolucci says they have strong incentives to extend the run: "If we stop the machine with 3,000 people apiece in the experiments waiting for data, there is no way we could get home at night without having slashed tyres on our cars."

The decision will be discussed at a meeting in the French town of Chamonix in late January, and should be finalized shortly after.

http://www.nature.com/news/2010/101210/full/news.2010.667.html?s=news_rss&utm_source=feedburner&utm_medium=feed&utm_campaign=Feed%3A+news%2Frss%2Fmost_recent+%28NatureNews+-+Most+recent+articles%29

If the plan is implemented, the Large Hadron Collider (LHC), located at CERN, near Geneva, Switzerland, will run until the end of 2012 — rather than 2011 — before entering a year-long shutdown for a major upgrade. Preparations for the extended run, which would see the 27-kilometre circular collider operating over three continuous years, are being finalized and are likely to be agreed to by CERN's management and council in January.

The decision comes with the belief that new discoveries may be just around the corner. "It would be a shame to stop," says Steve Myers, who is responsible for maintaining and upgrading the accelerator.

...

Initially, there were doubts about whether the LHC would be able to find the Higgs at the machine's current energies. Since a major accident in 2008, the LHC has been running at half its design energy. CERN managers had planned a 15-month pause in data collecting at the start of 2012, which would allow the machine to be upgraded to full power.

But now there is a growing consensus that the LHC will be able to cover most of the territory in which a standard Higgs particle might be found, even if it isn't upgraded. The best guess of most physicists is that the Higgs weighs somewhere between 114 and 600 gigaelectronvolts (109 electronvolts), according to Sergio Bertolucci, CERN's director for research and computing. Its mass will determine how the particle decays — and how easily it can be detected.

Paradoxically, a heavier Higgs might be easier to spot, Bertolucci says. That's because the heavy Higgs is likely to decay into pairs of rare, heavy particles known as W and Z bosons. Pairs of Ws or Zs would stand out sharply against the other particles created in LHC collisions. If the Higgs were lighter, its signature would blend into the background, making it much harder to detect and requiring physicists to amass and filter through data from months of collisions...

But keeping the machine running for an extra year will have consequences. The delicate alignment of the LHC's superconducting magnets could suffer, requiring extra maintenance, says Myers. And additional computing resources will have to be found to handle the flood of extra data produced by the detectors.

Managers recognize the difficulties, but Bertolucci says they have strong incentives to extend the run: "If we stop the machine with 3,000 people apiece in the experiments waiting for data, there is no way we could get home at night without having slashed tyres on our cars."

The decision will be discussed at a meeting in the French town of Chamonix in late January, and should be finalized shortly after.

... link (0 Kommentare) ... comment

Montag, 13. Dezember 2010

First Data LHC searching Higgs and SUSY!

klauslange,17:36h

Wichtige Ergebnisse der Michigan University vom 12.12. - 14.12.2010

Link zur Konferenz mit Video:

http://www.umich.edu/~mctp/LHC2010/prog.html

Link zur Konferenz mit Video:

http://www.umich.edu/~mctp/LHC2010/prog.html

... link (0 Kommentare) ... comment

Dienstag, 23. November 2010

Konzentrische Kreise in Hintergrundstrahlung...

klauslange,21:53h

... wurde bei Datenauswertung von WMAP und einer der Boomerang Mission entdeckt. Wenn diese Kreise wirklich vorhanden sind, ist das in der Tat eine interessante Neuigkeit. Doch wie in den Meldungen gemutmaßt wird, dass dies von einem Vorgängeruniversum vor dem Urknall stammen könnte, halte ich für gewagt.

Hier die Meldungen:

http://www.astronews.com/news/artikel/2010/11/1011-016.shtml

http://www.weltderphysik.de/de/4245.php?ni=2263

Zitat:

Penrose und Gurzadyan sind nun bei einer umfangreichen Analyse der WMAP-Daten auf eine Vielzahl konzentrischer Ringe gestoßen, in denen die Temperatur deutlich weniger schwankt als im Durchschnitt. Die Wahrscheinlichkeit für ein zufälliges Auftreten solcher Muster in den Daten sei geringer als 1 : 10 Millionen, so die Forscher. Nochmal erheblich niedriger sei die Wahrscheinlichkeit dafür, dass - wie beobachtet - mehrere Ringe konzentrisch auftreten, sich also um den gleichen Mittelpunkt gruppieren. Um ihren Fund weiter zu untermauern, haben Penrose und Gurzadyan außerdem Daten der Boomerang-Mission ausgewertet, eines Ballon-Teleskops, das die Hintergrundstrahlung in Teilbereichen des Himmels mit hoher Genauigkeit untersucht hat. Tatsächlich zeigten sich in den Boomerang-Daten die Ringe an den gleichen Stellen wie in den WMAP-Daten. Um einen Instrumenten-Effekt der WMAP-Detektoren kann es sich also nicht handeln.

Hier die Meldungen:

http://www.astronews.com/news/artikel/2010/11/1011-016.shtml

http://www.weltderphysik.de/de/4245.php?ni=2263

Zitat:

Penrose und Gurzadyan sind nun bei einer umfangreichen Analyse der WMAP-Daten auf eine Vielzahl konzentrischer Ringe gestoßen, in denen die Temperatur deutlich weniger schwankt als im Durchschnitt. Die Wahrscheinlichkeit für ein zufälliges Auftreten solcher Muster in den Daten sei geringer als 1 : 10 Millionen, so die Forscher. Nochmal erheblich niedriger sei die Wahrscheinlichkeit dafür, dass - wie beobachtet - mehrere Ringe konzentrisch auftreten, sich also um den gleichen Mittelpunkt gruppieren. Um ihren Fund weiter zu untermauern, haben Penrose und Gurzadyan außerdem Daten der Boomerang-Mission ausgewertet, eines Ballon-Teleskops, das die Hintergrundstrahlung in Teilbereichen des Himmels mit hoher Genauigkeit untersucht hat. Tatsächlich zeigten sich in den Boomerang-Daten die Ringe an den gleichen Stellen wie in den WMAP-Daten. Um einen Instrumenten-Effekt der WMAP-Detektoren kann es sich also nicht handeln.

... link (0 Kommentare) ... comment

Samstag, 20. November 2010

Durchbruch in der Quantentheorie!!!

klauslange,18:59h

Erst einmal nur kurz:

Wie berichtet wird gibt es einen erstaunlichen Durchbruch in der Quantentheorie. Unbestimmtheitsrelation und die sogenannte spukhafte Fernwirkung verschränkter Teilchen hängen zusammen, wobei letztere durch ersteres limitiert wird.

Hier ein Link zur Meldung:

http://www.sciencedaily.com/releases/2010/11/101118141541.htm

Zitat:

Stephanie Wehner of Singapore's Centre for Quantum Technologies and the National University of Singapore and Jonathan Oppenheim of the United Kingdom's University of Cambridge published their work in the latest edition of the journal Science.

The strange behaviour of quantum particles, such as atoms, electrons and the photons that make up light, has perplexed scientists for nearly a century. Albert Einstein was among those who thought the quantum world was so strange that quantum theory must be wrong, but experiments have borne out the theory's predictions.

One of the weird aspects of quantum theory is that it is impossible to know certain things, such as a particle's momentum and position, simultaneously. Knowledge of one of these properties affects the accuracy with which you can learn the other. This is known as the "Heisenberg Uncertainty Principle."

Another weird aspect is the quantum phenomenon of non-locality, which arises from the better-known phenomenon of entanglement. When two quantum particles are entangled, they can perform actions that look as if they are coordinated with each other in ways that defy classical intuition about physically separated particles.

Previously, researchers have treated non-locality and uncertainty as two separate phenomena. Now Wehner and Oppenheim have shown that they are intricately linked. What's more, they show that this link is quantitative and have found an equation which shows that the "amount" of non-locality is determined by the uncertainty principle.

"It's a surprising and perhaps ironic twist," said Oppenheim, a Royal Society University Research Fellow from the Department of Applied Mathematics & Theoretical Physics at the University of Cambridge. Einstein and his co-workers discovered non-locality while searching for a way to undermine the uncertainty principle. "Now the uncertainty principle appears to be biting back."

Non-locality determines how well two distant parties can coordinate their actions without sending each other information. Physicists believe that even in quantum mechanics, information cannot travel faster than light. Nevertheless, it turns out that quantum mechanics allows two parties to coordinate much better than would be possible under the laws of classical physics. In fact, their actions can be coordinated in a way that almost seems as if they had been able to talk. Einstein famously referred to this phenomenon as "spooky action at a distance."

However, quantum non-locality could be even spookier than it actually is. It's possible to have theories which allow distant parties to coordinate their actions much better than nature allows, while still not allowing information to travel faster than light. Nature could be weirder, and yet it isn't -- quantum theory appears to impose an additional limit on the weirdness.

"Quantum theory is pretty weird, but it isn't as weird as it could be. We really have to ask ourselves, why is quantum mechanics this limited? Why doesn't nature allow even stronger non-locality?" Oppenheim says.

The surprising result by Wehner and Oppenheim is that the uncertainty principle provides an answer. Two parties can only coordinate their actions better if they break the uncertainty principle, which imposes a strict bound on how strong non-locality can be.

"It would be great if we could better coordinate our actions over long distances, as it would enable us to solve many information processing tasks very efficiently," Wehner says. "However, physics would be fundamentally different. If we break the uncertainty principle, there is really no telling what our world would look like."

How did the researchers discover a connection that had gone unnoticed so long? Before entering academia, Wehner worked as a 'computer hacker for hire', and now works in quantum information theory, while Oppenheim is a physicist. Wehner thinks that applying techniques from computer science to the laws of theoretical physics was key to spotting the connection. "I think one of the crucial ideas is to link the question to a coding problem," Wehner says. "Traditional ways of viewing non-locality and uncertainty obscured the close connection between the two concepts."

Wehner and Oppenheim recast the phenomena of quantum physics in terms that would be familiar to a computer hacker. They treat non-locality as the result of one party, Alice, creating and encoding information and a second party, Bob, retrieving information from the encoding. How well Alice and Bob can encode and retrieve information is determined by uncertainty relations. In some situations, they found that and a third property known as "steering" enters the picture.

Wehner and Oppenheim compare their discovery to uncovering what determines how easily two players can win a quantum board game: the board has only two squares, on which Alice, can place a counter of two possible colours: green or pink. She is told to place the same colour on both squares, or to place a different colour on each. Bob has to guess the colour that Alice put on square one or two. If his guess is correct, Alice and Bob win the game. Clearly, Alice and Bob could win the game if they could talk to each other: Alice would simply tell Bob what colours are on squares one and two. But Bob and Alice are situated so far apart from each other that light -- and thus an information-carrying signal -- does not have time to pass between them during the game.

If they can't talk, they won't always win, but by measuring on quantum particles, they can win the game more often than any strategy which doesn't rely on quantum theory. However, the uncertainty principle prevents them from doing any better, and even determines how often they lose the game.

The finding bears on the deep question of what principles underlie quantum physics. Many attempts to understand the underpinnings of quantum mechanics have focused on non-locality. Wehner thinks there may be more to gain from examining the details of the uncertainty principle. "However, we have barely scratched the surface of understanding uncertainty relations," she says.

Wie berichtet wird gibt es einen erstaunlichen Durchbruch in der Quantentheorie. Unbestimmtheitsrelation und die sogenannte spukhafte Fernwirkung verschränkter Teilchen hängen zusammen, wobei letztere durch ersteres limitiert wird.

Hier ein Link zur Meldung:

http://www.sciencedaily.com/releases/2010/11/101118141541.htm

Zitat:

Stephanie Wehner of Singapore's Centre for Quantum Technologies and the National University of Singapore and Jonathan Oppenheim of the United Kingdom's University of Cambridge published their work in the latest edition of the journal Science.

The strange behaviour of quantum particles, such as atoms, electrons and the photons that make up light, has perplexed scientists for nearly a century. Albert Einstein was among those who thought the quantum world was so strange that quantum theory must be wrong, but experiments have borne out the theory's predictions.

One of the weird aspects of quantum theory is that it is impossible to know certain things, such as a particle's momentum and position, simultaneously. Knowledge of one of these properties affects the accuracy with which you can learn the other. This is known as the "Heisenberg Uncertainty Principle."

Another weird aspect is the quantum phenomenon of non-locality, which arises from the better-known phenomenon of entanglement. When two quantum particles are entangled, they can perform actions that look as if they are coordinated with each other in ways that defy classical intuition about physically separated particles.

Previously, researchers have treated non-locality and uncertainty as two separate phenomena. Now Wehner and Oppenheim have shown that they are intricately linked. What's more, they show that this link is quantitative and have found an equation which shows that the "amount" of non-locality is determined by the uncertainty principle.

"It's a surprising and perhaps ironic twist," said Oppenheim, a Royal Society University Research Fellow from the Department of Applied Mathematics & Theoretical Physics at the University of Cambridge. Einstein and his co-workers discovered non-locality while searching for a way to undermine the uncertainty principle. "Now the uncertainty principle appears to be biting back."

Non-locality determines how well two distant parties can coordinate their actions without sending each other information. Physicists believe that even in quantum mechanics, information cannot travel faster than light. Nevertheless, it turns out that quantum mechanics allows two parties to coordinate much better than would be possible under the laws of classical physics. In fact, their actions can be coordinated in a way that almost seems as if they had been able to talk. Einstein famously referred to this phenomenon as "spooky action at a distance."

However, quantum non-locality could be even spookier than it actually is. It's possible to have theories which allow distant parties to coordinate their actions much better than nature allows, while still not allowing information to travel faster than light. Nature could be weirder, and yet it isn't -- quantum theory appears to impose an additional limit on the weirdness.

"Quantum theory is pretty weird, but it isn't as weird as it could be. We really have to ask ourselves, why is quantum mechanics this limited? Why doesn't nature allow even stronger non-locality?" Oppenheim says.

The surprising result by Wehner and Oppenheim is that the uncertainty principle provides an answer. Two parties can only coordinate their actions better if they break the uncertainty principle, which imposes a strict bound on how strong non-locality can be.

"It would be great if we could better coordinate our actions over long distances, as it would enable us to solve many information processing tasks very efficiently," Wehner says. "However, physics would be fundamentally different. If we break the uncertainty principle, there is really no telling what our world would look like."

How did the researchers discover a connection that had gone unnoticed so long? Before entering academia, Wehner worked as a 'computer hacker for hire', and now works in quantum information theory, while Oppenheim is a physicist. Wehner thinks that applying techniques from computer science to the laws of theoretical physics was key to spotting the connection. "I think one of the crucial ideas is to link the question to a coding problem," Wehner says. "Traditional ways of viewing non-locality and uncertainty obscured the close connection between the two concepts."

Wehner and Oppenheim recast the phenomena of quantum physics in terms that would be familiar to a computer hacker. They treat non-locality as the result of one party, Alice, creating and encoding information and a second party, Bob, retrieving information from the encoding. How well Alice and Bob can encode and retrieve information is determined by uncertainty relations. In some situations, they found that and a third property known as "steering" enters the picture.

Wehner and Oppenheim compare their discovery to uncovering what determines how easily two players can win a quantum board game: the board has only two squares, on which Alice, can place a counter of two possible colours: green or pink. She is told to place the same colour on both squares, or to place a different colour on each. Bob has to guess the colour that Alice put on square one or two. If his guess is correct, Alice and Bob win the game. Clearly, Alice and Bob could win the game if they could talk to each other: Alice would simply tell Bob what colours are on squares one and two. But Bob and Alice are situated so far apart from each other that light -- and thus an information-carrying signal -- does not have time to pass between them during the game.

If they can't talk, they won't always win, but by measuring on quantum particles, they can win the game more often than any strategy which doesn't rely on quantum theory. However, the uncertainty principle prevents them from doing any better, and even determines how often they lose the game.

The finding bears on the deep question of what principles underlie quantum physics. Many attempts to understand the underpinnings of quantum mechanics have focused on non-locality. Wehner thinks there may be more to gain from examining the details of the uncertainty principle. "However, we have barely scratched the surface of understanding uncertainty relations," she says.

... link (0 Kommentare) ... comment

Donnerstag, 18. November 2010

Anti-Wasserstoff am LHC eingefangen...

klauslange,21:42h

...zumindest für 0,17 Sekunden, aber immerhin ein erster Schritt für wichtige Untersuchungen der Anti-Materie.

Hier eine Auswahl mehrerer Berichte:

http://www.astronews.com/news/artikel/2010/11/1011-014.shtml

http://www.scinexx.de/wissen-aktuell-12579-2010-11-18.html

Daraus:

2002 gelang erstmals für wenige Sekundenbruchteile die Produktion eines Antiwasserstoffatoms bestehend aus einem Antiproton und einem Positron am Experiment ALPHA (Antihydrogen Laser PHysics Apparatus) des Kernforschungszentrum CERN bei Genf.

Schwer einzufangen

Doch eine Möglichkeit, dieses ungeladene Teilchen einzufangen oder gar für weiter gehende Untersuchungen zu speichern, gab es bisher nicht. Denn sobald das frisch erzeugte Antiwasserstoffteilchen der es umgebenden Materie zu nahe kommt, wird es ausgelöscht und löst sich in einer Art Explosion in Energie auf. Erste Voraussetzung für eine „Antimateriefalle“ ist daher eine extrem starke Abkühlung der Antiwasserstoffteilchen und der sie erzeugenden Positronen und Antiprotonen. Bei nur 0,5 Kelvin, einer Temperatur nahe am absoluten Nullpunkt, wird ihre Eigenbewegung so gering und langsam, dass ein Einfangen mit Hilfe magnetischer „Käfige“ erst möglich wird.

Achtpolige Magnetanordnung als Käfig

Einen solchen Käfig haben jetzt Forscher einer internationalen Kollaboration am CERN entwickelt und erfolgreich getestet: „Wir konnten 38 Atome einfangen, was eine unglaublich geringe Menge ist, weit von dem entfernt, was wir bräuchten um das Raumschiff Enterprise anzutreiben“, erklärt Rob Thompson, Physiker der Universität von Calgary und einer der Forscher der ALPHA-Kollaboration.

Und auch wissenschaft.de soll nicht fehlen:

http://www.wissenschaft.de/wissenschaft/news/312368.html

Hier eine Auswahl mehrerer Berichte:

http://www.astronews.com/news/artikel/2010/11/1011-014.shtml

http://www.scinexx.de/wissen-aktuell-12579-2010-11-18.html

Daraus:

2002 gelang erstmals für wenige Sekundenbruchteile die Produktion eines Antiwasserstoffatoms bestehend aus einem Antiproton und einem Positron am Experiment ALPHA (Antihydrogen Laser PHysics Apparatus) des Kernforschungszentrum CERN bei Genf.

Schwer einzufangen

Doch eine Möglichkeit, dieses ungeladene Teilchen einzufangen oder gar für weiter gehende Untersuchungen zu speichern, gab es bisher nicht. Denn sobald das frisch erzeugte Antiwasserstoffteilchen der es umgebenden Materie zu nahe kommt, wird es ausgelöscht und löst sich in einer Art Explosion in Energie auf. Erste Voraussetzung für eine „Antimateriefalle“ ist daher eine extrem starke Abkühlung der Antiwasserstoffteilchen und der sie erzeugenden Positronen und Antiprotonen. Bei nur 0,5 Kelvin, einer Temperatur nahe am absoluten Nullpunkt, wird ihre Eigenbewegung so gering und langsam, dass ein Einfangen mit Hilfe magnetischer „Käfige“ erst möglich wird.

Achtpolige Magnetanordnung als Käfig

Einen solchen Käfig haben jetzt Forscher einer internationalen Kollaboration am CERN entwickelt und erfolgreich getestet: „Wir konnten 38 Atome einfangen, was eine unglaublich geringe Menge ist, weit von dem entfernt, was wir bräuchten um das Raumschiff Enterprise anzutreiben“, erklärt Rob Thompson, Physiker der Universität von Calgary und einer der Forscher der ALPHA-Kollaboration.

Und auch wissenschaft.de soll nicht fehlen:

http://www.wissenschaft.de/wissenschaft/news/312368.html

... link (0 Kommentare) ... comment

... nächste Seite